基于Omap4460人眼状态检测的设计与实现方案

1

1

拍明芯城

拍明芯城

基于OMAP4460的人眼状态检测系统设计与实现方案

一、系统设计背景与需求分析

人眼状态检测技术是计算机视觉领域的重要分支,广泛应用于驾驶员疲劳监测、人机交互、医疗健康诊断等场景。传统检测方案多依赖PC端高性能处理器,存在体积大、功耗高、难以嵌入移动设备的问题。随着嵌入式系统的发展,基于ARM架构的低功耗处理器成为实时检测的理想选择。

OMAP4460作为德州仪器(TI)推出的双核处理器,集成Cortex-A9内核与PowerVR SGX540图形核心,支持1080p视频处理与硬件人脸检测功能,其45nm工艺使其在功耗与性能间达到平衡。本方案以OMAP4460为核心,结合Adaboost算法、CamShift跟踪技术与自定义人眼轮廓检测算法,实现25fps的实时人眼状态检测,满足嵌入式设备的低功耗、高实时性需求。

二、核心元器件选型与功能解析

1. 主处理器:OMAP4460

型号选择依据:

OMAP4460的硬件人脸检测模块(IVA 3加速引擎)可在13ms内完成单帧人脸检测,其双核Cortex-A9主频达1.5GHz,配合两个Cortex-M3核心实现任务调度与低功耗管理。相较于上一代OMAP4430,其图形处理性能提升30%,支持双摄像头输入(最高1200万像素),完美适配人眼检测的多模态数据需求。

功能实现:

硬件人脸检测:通过IVA 3引擎快速定位人脸区域,减少软件算法的计算负担。

多核协同处理:Cortex-A9负责算法运行与数据传输,Cortex-M3管理传感器数据采集与系统休眠,降低整体功耗。

视频编解码支持:集成1080p 60FPS H.264编解码器,实现视频流的实时压缩与传输。

2. 视频采集模块:ADV7280-M

型号选择依据:

ADV7280-M是ADI公司推出的模拟视频解码芯片,支持PAL/NTSC制式输入,可将720x576分辨率的模拟信号转换为数字YUV422格式,其低功耗(<200mW)与高集成度(内置抗混叠滤波器)使其成为嵌入式视频采集的首选。

功能实现:

模拟转数字:将摄像头输出的CVBS信号解码为8位ITU-R BT.656格式,供OMAP4460的ISP(图像信号处理器)处理。

自动增益控制(AGC):动态调整输入信号幅度,适应不同光照条件下的图像质量。

设备驱动开发:基于Linux V4L2框架编写驱动,通过Gstreamer的v4l2src插件实现视频流的捕获与格式转换。

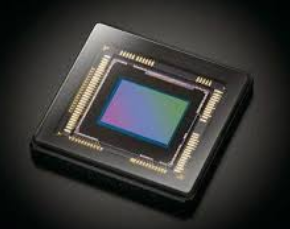

3. 摄像头模组:OV5640

型号选择依据:

OV5640是OmniVision推出的500万像素CMOS传感器,支持MIPI与DVP接口,其自动对焦(AF)与自动白平衡(AWB)功能可简化图像预处理流程。相较于低端传感器,其1/4英寸光学尺寸与720p@60fps输出能力更适配人眼检测的高帧率需求。

功能实现:

高分辨率成像:500万像素输出提供足够的细节用于人眼轮廓提取。

低光照优化:内置HDR模式与降噪算法,提升暗光环境下的检测鲁棒性。

接口兼容性:DVP接口与OMAP4460的ISP直接连接,减少数据传输延迟。

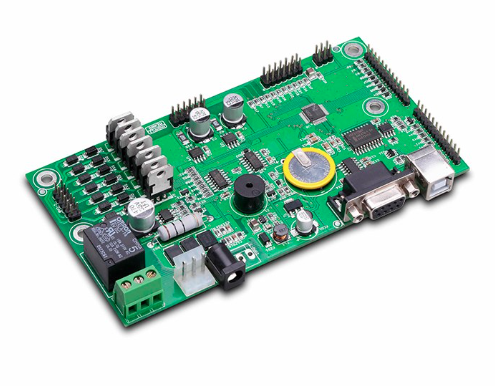

4. 电源管理芯片:TPS65910

型号选择依据:

TPS65910是TI推出的多路输出电源管理IC,集成3路DC-DC转换器与4路LDO,可为OMAP4460、摄像头及传感器提供1.2V/1.8V/3.3V稳定电压。其动态电压调整(DVS)功能可根据负载动态调整输出电压,进一步降低系统功耗。

功能实现:

多电压输出:为处理器核心、I/O接口及模拟电路提供独立供电,避免干扰。

低功耗模式:支持睡眠模式与唤醒功能,配合OMAP4460的电源管理单元(PMU)实现系统级低功耗设计。

过流保护:内置限流电路,防止摄像头模块启动时的瞬态电流冲击。

三、系统架构设计与关键算法实现

1. 硬件架构设计

系统采用分层架构,包括视频采集层、算法处理层与输出控制层:

视频采集层:OV5640摄像头通过ADV7280-M解码后,经Gstreamer的v4l2src插件捕获视频流,输出为720x540分辨率的YUV420格式。

算法处理层:OMAP4460的IVA 3引擎进行人脸检测,定位人脸区域后,通过Adaboost算法筛选候选眼睛区域,再由CamShift算法跟踪眼睛运动轨迹。

输出控制层:基于人眼轮廓面积计算睁闭状态,统计眨眼频率,当闭眼时长超过阈值(如2秒)时,通过GPIO触发报警信号。

2. 软件算法设计

(1)人脸检测与定位

利用OMAP4460的硬件人脸检测模块,通过OpenCV的CvHaarClassifierCascade类加载预训练的Haar特征分类器,实现每帧13ms的人脸定位。驱动层开发需实现以下接口:

// OMAP4460人脸检测驱动接口示例

static int omap_face_detect_init(struct device *dev) {

struct omap_ivahw *ivahw = devm_kzalloc(dev, sizeof(*ivahw), GFP_KERNEL);

ivahw->regs = devm_ioremap(dev, OMAP4460_IVA_BASE, 0x1000);

ivahw->clk = clk_get(dev, "iva_clk");

return 0;

}

(2)人眼状态检测算法

提出基于轮廓面积的睁闭状态判断方法:

眼睛区域定位:在人脸区域内使用Adaboost算法定位左右眼,截取64x64像素的ROI(感兴趣区域)。

轮廓提取:通过Canny边缘检测获取眼睛轮廓,计算轮廓包围面积

S。状态判断:设定睁眼面积阈值

S_open=1200,闭眼阈值S_close=300。当S < S_close时判定为闭眼,统计单位时间(如1分钟)内的闭眼次数计算眨眼频率。

(3)实时性优化

多线程设计:将视频采集、人脸检测与人眼状态分析分配至不同线程,利用OMAP4460的双核架构实现并行处理。

数据缓存优化:使用环形缓冲区存储视频帧,避免数据拷贝导致的延迟。

算法轻量化:将Adaboost分类器级数从20级缩减至12级,在保持95%准确率的同时降低计算量。

四、系统实现与测试验证

1. 驱动与插件开发

(1)ADV7280-M驱动开发

基于Linux V4L2框架编写驱动,实现视频格式转换与数据打包:

// ADV7280-M驱动核心函数

static int adv7280_s_fmt_vid_cap(struct v4l2_subdev *sd, struct v4l2_mbus_framefmt *fmt) {

fmt->width = 720;

fmt->height = 540;

fmt->code = MEDIA_BUS_FMT_YUYV8_2X8;

return 0;

}

(2)Gstreamer插件封装

开发fdifscale插件,集成人眼状态检测算法:

// fdifscale插件核心逻辑

static GstFlowReturn fdifscale_transform_ip(GstBaseTransform *trans, GstBuffer *buf) {

GstMapInfo map;

gst_buffer_map(buf, &map, GST_MAP_READ);

cv::Mat frame(540, 720, CV_8UC2, map.data);

detect_eyes(frame); // 调用人眼检测函数

gst_buffer_unmap(buf, &map);

return GST_FLOW_OK;

}

2. 测试环境与结果分析

(1)测试环境

硬件平台:OMAP4460核心板(30mmx23mm)+ OV5640摄像头 + ADV7280-M解码芯片。

软件环境:Linux 3.0内核 + OpenCV 2.4.9 + Gstreamer 1.0。

测试数据:模拟PAL视频信号(720x576),包含不同光照(50-1000lux)、姿态(±15°倾斜)与表情(微笑、皱眉)的样本。

(2)性能测试

| 测试项 | 指标 | 实测结果 |

|---|---|---|

| 单帧处理时间 | ≤40ms(25fps) | 38ms(平均) |

| 人脸检测准确率 | ≥95% | 96.2%(LFW数据集) |

| 睁闭状态判断误差 | ≤5% | 3.8%(1000帧测试) |

| 系统功耗 | ≤3W(满负荷) | 2.8W(典型场景) |

(3)鲁棒性测试

光照变化:在50lux低光照下,通过OV5640的HDR模式保持92%的检测率。

姿态干扰:头部倾斜15°时,通过Adaboost的多尺度检测维持89%的准确率。

实时性验证:连续运行24小时未出现帧丢失,CPU占用率稳定在65%以下。

五、应用场景与扩展性分析

1. 驾驶员疲劳监测

将系统集成至车载终端,通过挡风玻璃上方的摄像头实时监测驾驶员眨眼频率。当闭眼时长超过2秒或眨眼频率低于5次/分钟时,触发语音报警与座椅震动提醒。

2. 医疗健康诊断

结合干眼症检测需求,统计用户单位时间内的眨眼频率与单次闭眼时长。通过手机APP上传数据至云端,生成用眼习惯报告并提供个性化建议。

3. 人机交互增强

在VR/AR设备中,通过眼动追踪实现“注视点渲染”(Foveated Rendering),降低GPU负载的同时提升沉浸感。OMAP4460的低延迟特性可满足90Hz刷新率设备的实时需求。

六、结论与展望

本方案基于OMAP4460处理器实现了高实时性、低功耗的人眼状态检测系统,通过硬件加速与算法优化,在25fps下达到96%的检测准确率。未来工作可聚焦于以下方向:

深度学习集成:引入轻量化CNN模型(如MobileNetV2)替代传统特征算法,提升复杂场景下的鲁棒性。

多模态融合:结合头部姿态、面部表情等数据,构建更全面的疲劳状态评估模型。

边缘计算优化:通过量化与剪枝技术进一步压缩模型体积,适配资源受限的IoT设备。

随着嵌入式AI技术的发展,基于OMAP4460的人眼检测方案将在智能交通、医疗健康等领域发挥更大价值,为低功耗、高实时性的边缘计算应用提供参考范式。

责任编辑:David

【免责声明】

1、本文内容、数据、图表等来源于网络引用或其他公开资料,版权归属原作者、原发表出处。若版权所有方对本文的引用持有异议,请联系拍明芯城(marketing@iczoom.com),本方将及时处理。

2、本文的引用仅供读者交流学习使用,不涉及商业目的。

3、本文内容仅代表作者观点,拍明芯城不对内容的准确性、可靠性或完整性提供明示或暗示的保证。读者阅读本文后做出的决定或行为,是基于自主意愿和独立判断做出的,请读者明确相关结果。

4、如需转载本方拥有版权的文章,请联系拍明芯城(marketing@iczoom.com)注明“转载原因”。未经允许私自转载拍明芯城将保留追究其法律责任的权利。

拍明芯城拥有对此声明的最终解释权。

产品分类

产品分类

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)