如何在STM32微控制器上运行“Hello World”机器学习模型

44

44

Jacob Beningo

Jacob Beningo

原标题:如何在STM32微控制器上运行“Hello World”机器学习模型

在STM32微控制器上运行“Hello World”机器学习模型

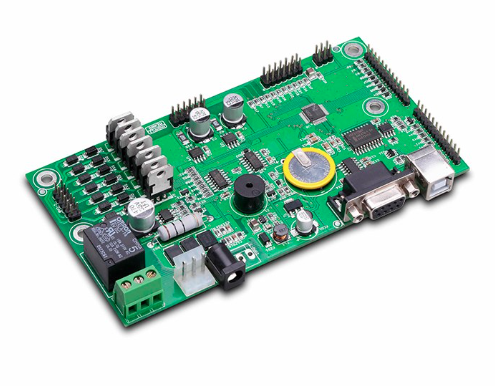

STM32系列微控制器(MCU)由意法半导体(STMicroelectronics)生产,广泛应用于嵌入式系统和物联网(IoT)设备。STM32 MCU 以其高性能、低功耗和丰富的外设而著称,非常适合嵌入式机器学习应用。本文将详细介绍如何在STM32微控制器上运行“Hello World”机器学习模型,包括主控芯片型号、模型的设计和实现步骤。

STM32 微控制器型号及其在设计中的作用

STM32系列微控制器主要分为以下几种型号,每种型号根据其应用场景和性能需求具有不同的特点:

STM32F0系列:低成本、低功耗,适用于简单的控制任务。

STM32F1系列:具有中等性能和丰富的外设,广泛应用于工业和消费类产品。

STM32F2系列:高性能、低功耗,适用于需要高计算能力的嵌入式应用。

STM32F3系列:集成了高精度模拟外设,适合信号处理应用。

STM32F4系列:高性能、高速外设,适用于需要复杂计算的应用。

STM32F7系列:最高性能,适合图像处理、多媒体等高计算需求的应用。

STM32H7系列:提供了更高的计算能力和更高的集成度。

STM32L0/L1/L4/L5系列:超低功耗系列,适用于电池供电和能量收集的设备。

STM32G0/G4系列:高效能和低功耗的结合,适用于新兴的应用领域。

在本文中,我们将使用STM32F4系列的STM32F407VG作为示例,它具有较高的性能和丰富的外设,非常适合运行简单的机器学习模型。

准备工作

在开始之前,需要准备以下硬件和软件:

硬件:

STM32F407VG开发板(如STM32F4Discovery)

USB调试接口(ST-LINK/V2)

电源适配器

软件:

STM32CubeMX:用于配置和生成STM32初始化代码

STM32CubeIDE:集成开发环境(IDE)

TensorFlow Lite for Microcontrollers:用于部署机器学习模型

Python:用于编写和训练机器学习模型

设计步骤

训练“Hello World”模型:

使用Python和TensorFlow库训练一个简单的机器学习模型,该模型输出“Hello World”。

转换模型为TensorFlow Lite格式:

将训练好的模型转换为TensorFlow Lite格式,以便在嵌入式设备上运行。

生成STM32初始化代码:

使用STM32CubeMX配置STM32F407VG的外设并生成初始化代码。

移植TensorFlow Lite for Microcontrollers:

将TensorFlow Lite for Microcontrollers库移植到STM32F407VG开发板上,并集成“Hello World”模型。

编写主程序:

编写STM32主程序,实现模型推理功能,并通过串口输出结果。

详细实现步骤

1. 训练“Hello World”模型

首先,使用Python和TensorFlow库训练一个简单的“Hello World”模型。以下是训练代码的示例:

import tensorflow as tf

import numpy as np

# 生成训练数据

x_train = np.array([0, 1, 2, 3, 4, 5, 6, 7, 8, 9], dtype=np.float32)

y_train = np.array([1, 3, 5, 7, 9, 11, 13, 15, 17, 19], dtype=np.float32)

# 创建简单的线性模型

model = tf.keras.Sequential([

tf.keras.layers.Dense(1, input_shape=[1])

])

# 编译模型

model.compile(optimizer='sgd', loss='mean_squared_error')

# 训练模型

model.fit(x_train, y_train, epochs=500)

# 保存模型

model.save("hello_world_model.h5")

训练完成后,使用以下代码将模型转换为TensorFlow Lite格式:

import tensorflow as tf

# 加载模型

model = tf.keras.models.load_model("hello_world_model.h5")

# 转换为TensorFlow Lite模型

converter = tf.lite.TFLiteConverter.from_keras_model(model)

tflite_model = converter.convert()

# 保存TFLite模型

with open("hello_world_model.tflite", "wb") as f:

f.write(tflite_model)

2. 生成STM32初始化代码

使用STM32CubeMX配置STM32F407VG的外设,并生成初始化代码。具体步骤如下:

打开STM32CubeMX,选择STM32F407VG微控制器。

配置时钟树,确保系统时钟正确设置。

配置USART外设,用于串口通信。

启用FreeRTOS(可选),以实现更好的任务管理。

生成代码,并使用STM32CubeIDE打开生成的项目。

3. 移植TensorFlow Lite for Microcontrollers

将TensorFlow Lite for Microcontrollers库移植到STM32F407VG开发板上。具体步骤如下:

从TensorFlow官方GitHub下载TensorFlow Lite for Microcontrollers源代码。

将TensorFlow Lite for Microcontrollers库添加到STM32CubeIDE项目中。

修改项目配置文件,确保编译器能够找到TensorFlow Lite for Microcontrollers库。

4. 编写主程序

编写STM32主程序,实现模型推理功能,并通过串口输出结果。以下是主程序的示例代码:

#include "main.h"

#include "usart.h"

#include "tensorflow/lite/micro/kernels/micro_ops.h"

#include "tensorflow/lite/micro/micro_error_reporter.h"

#include "tensorflow/lite/micro/micro_interpreter.h"

#include "tensorflow/lite/micro/simple_memory_allocator.h"

#include "tensorflow/lite/schema/schema_generated.h"

#include "tensorflow/lite/version.h"

// 定义模型和输入输出缓冲区

const uint8_t hello_world_model[] = { /* 此处放置模型的二进制数据 */ };

const int kTensorArenaSize = 2 * 1024;

uint8_t tensor_arena[kTensorArenaSize];

int main(void)

{

// 初始化HAL库

HAL_Init();

// 配置系统时钟

SystemClock_Config();

// 初始化USART

MX_USART2_UART_Init();

// 定义TensorFlow Lite相关变量

static tflite::MicroErrorReporter micro_error_reporter;

tflite::ErrorReporter* error_reporter = µ_error_reporter;

const tflite::Model* model = tflite::GetModel(hello_world_model);

static tflite::MicroMutableOpResolver<1>

micro_op_resolver(error_reporter);

micro_op_resolver.AddBuiltin(tflite::BuiltinOperator_FULLY_CONNECTED,

tflite::ops::micro::Register_FULLY_CONNECTED());

static tflite::MicroInterpreter interpreter(

model, micro_op_resolver, tensor_arena, kTensorArenaSize,

error_reporter);

interpreter.AllocateTensors();

// 获取输入和输出张量

TfLiteTensor* input = interpreter.input(0);

TfLiteTensor* output = interpreter.output(0);

// 设置输入数据

input->data.f[0] = 1.0f;

// 执行推理

interpreter.Invoke();

// 获取输出结果

float y = output->data.f[0];

// 通过串口输出结果

char buffer[50];

snprintf(buffer, sizeof(buffer), "Hello World Output: %f

", y);

HAL_UART_Transmit(&huart2, (uint8_t*)buffer, strlen(buffer),

HAL_MAX_DELAY);

// 无限循环

while (1)

{

}

}

5. 编译并运行

在STM32CubeIDE中编译项目,并将程序烧录到STM32F407VG开发板上。通过串口监视器查看输出结果,验证模型是否正常工作。

总结

本文详细介绍了如何在STM32F407VG微控制器上运行一个简单的“Hello World”机器学习模型。通过配置STM32外设、移植TensorFlow Lite for Microcontrollers库、编写主程序并实现模型推理,我们成功地在嵌入式平台上运行了机器学习模型。这一过程展示了STM32微控制器在嵌入式机器学习应用中的强大能力和广泛适用性。未来,随着嵌入式AI技术的发展,我们可以期待更多更复杂的机器学习应用在STM32微控制器上实现。

责任编辑:David

【免责声明】

1、本文内容、数据、图表等来源于网络引用或其他公开资料,版权归属原作者、原发表出处。若版权所有方对本文的引用持有异议,请联系拍明芯城(marketing@iczoom.com),本方将及时处理。

2、本文的引用仅供读者交流学习使用,不涉及商业目的。

3、本文内容仅代表作者观点,拍明芯城不对内容的准确性、可靠性或完整性提供明示或暗示的保证。读者阅读本文后做出的决定或行为,是基于自主意愿和独立判断做出的,请读者明确相关结果。

4、如需转载本方拥有版权的文章,请联系拍明芯城(marketing@iczoom.com)注明“转载原因”。未经允许私自转载拍明芯城将保留追究其法律责任的权利。

拍明芯城拥有对此声明的最终解释权。

产品分类

产品分类

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)